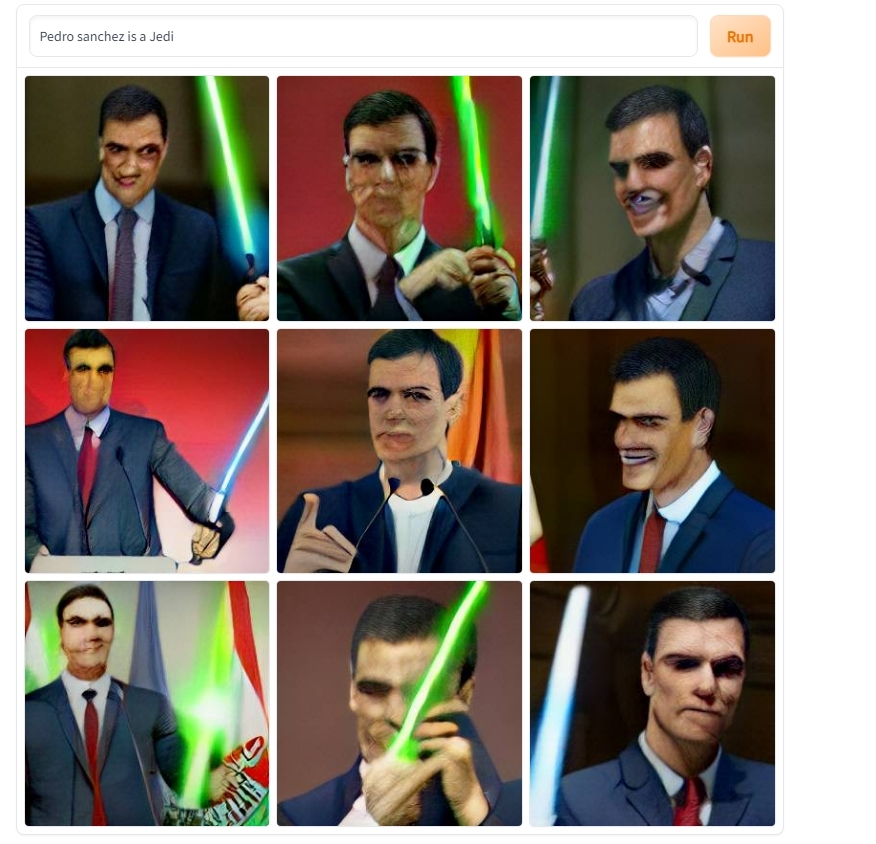

Las primeras imágenes de la nueva pelicula.

#31 brutal xDDDD, vaya puñalada trapera la primera de la segunda fila. Segunda parte de la trilogia, luego continuas tu! xD

#46 Si es que solo falta un sistema de feedback humano-maquina para que creen cosas dependiendo de la retención, likes o feedback en redes y solo salgan cosas que le gusten a to dios

No se como funcionara pero da miedo.

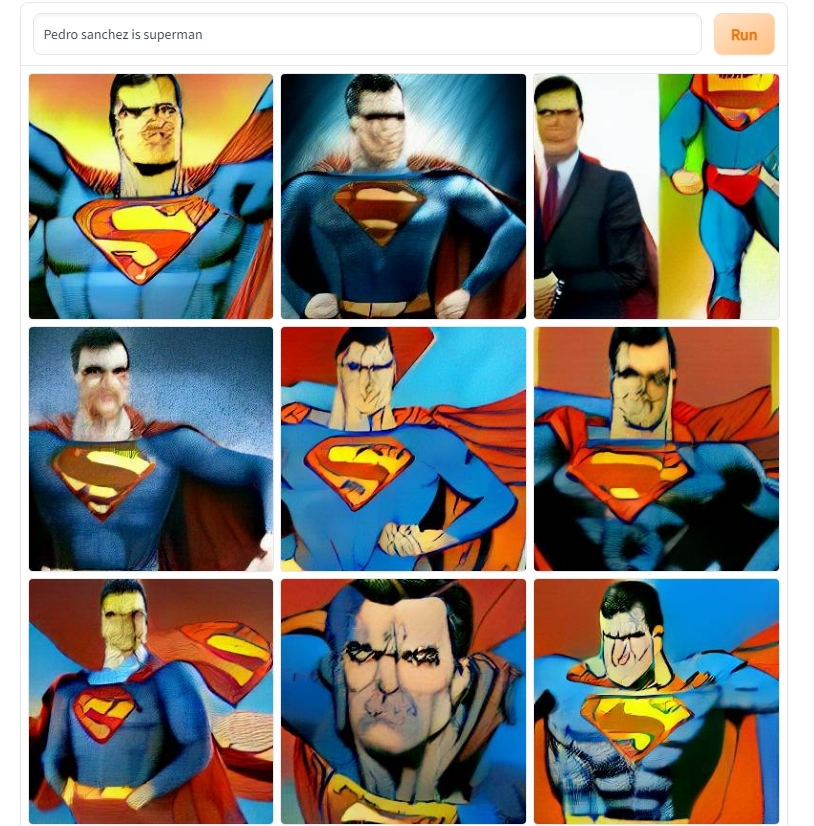

Veo que esta IA está fuertemente influenciada por el estilo de la octogenaria restauradora del eccehomo de Borja.

#8 No solo está disponible para la gente de OpenAI. Desde que salió el paper tienen beta cerrada con invitación, y puedes pedirla (tienes que ser desarrollador y que te la acepten). Youtube y Twitter tienen bastante gente trasteando con ello y con directos.

Querían sacar una versión comercial para este año/principios del siguiente, pero tienen miedo de que use para hacer contenidos ilícitos o no 'consumer-friendly' (deepfakes, pornografía, gore, etc.) y están viendo como caparlo.

Y Google tiene su propio modelo que también anda cerca de DALL-E 2, pero este es completamente cerrado igual que su versión de GPT3.

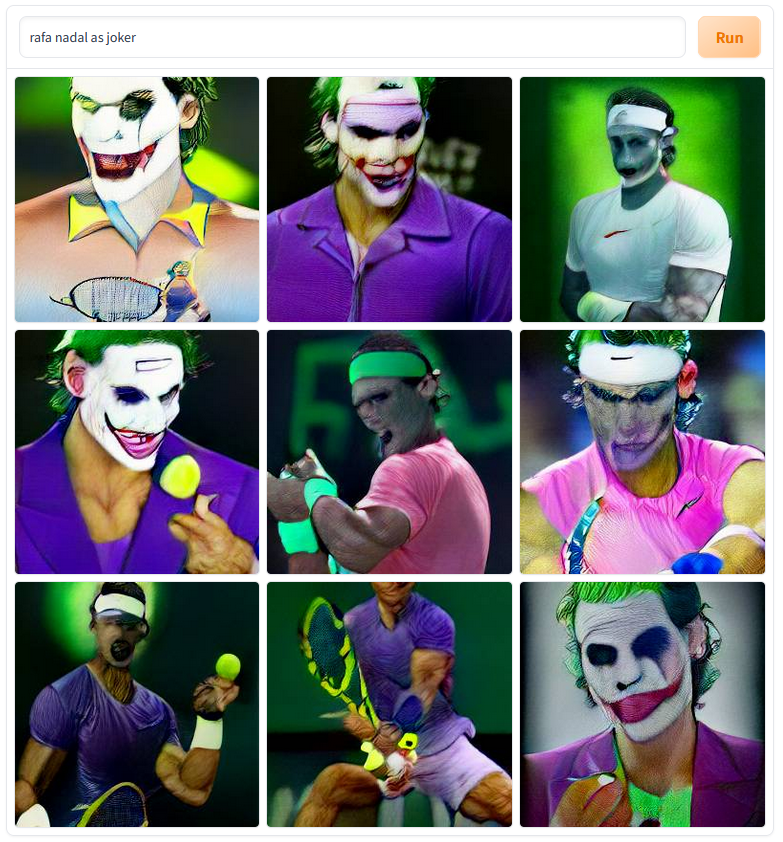

Vamos, estos clones están un par de generaciones por debajo, pero no van mal encaminados. De hecho, hace unos días empezaron a usarlo por varios subforos en 4chan y cada vez da mejores resultados. Muy lejos de DALL-E 2, pero no parece que estemos a muchps años algo así comercial con varias empresas alquilando usos como pasa con los transformadores de texto ya.

Ya lo puse en el post #13 que había confundido con la de Google, por eso puse que era cerrada a todo el mundo.

Pero vamos que no cambia que el acceso sigue sin ser público y todas las que te dejan generar tus propios ejemplos de forma libre son clones basados en el paper por qué el código del transformador no se ha liberado ni hay planes de hacerlo

Me recuerda al hilo del verano pasado donde podías hacer cosas tan maravillosas como esta:

Death Stranding by Salvador Dali:

https://www.mediavida.com/foro/off-topic/texto-imagen-tipicas-ias-673577